OpenAI a récemment pris des mesures décisives. La plateforme a supprimé plusieurs groupes de comptes qui exploitaient illégalement ses outils pour mener des campagnes de propagande, des arnaques et des opérations d’influence.

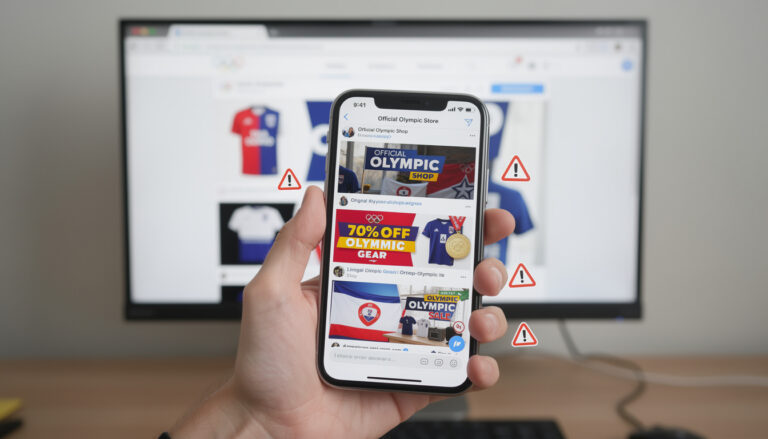

Le géant de l’intelligence artificielle a annoncé la suppression de plusieurs groupes de comptes utilisés pour la propagande, les arnaques et les opérations d’influence. La modération accrue vise à protéger la sécurité en ligne et à contenir la désinformation massive qui menace les internautes. Les équipes d’OpenAI précisent que ces mesures ciblent spécifiquement les réseaux organisés qui exploitent ses outils à des fins malveillantes, marquant un tournant dans la lutte contre la manipulation en ligne et les campagnes frauduleuses.

OpenAI face aux menaces de manipulations en ligne

Au début de l’année 2026, OpenAI a désactivé un ensemble de groupes de comptes impliqués dans des activités frauduleuses, notamment en provenance de réseaux liés à divers États et acteurs non étatiques. Ce nettoyage est la réponse à une recrudescence d’usage malveillant de ses modèles génératifs pour propager de la propagande sophistiquée et des attaques d’arnaques émotionnelles ou financières.

Avec l’essor des technologies d’IA, ces dispositifs sont devenus des armes redoutables dans la lutte contre la fraude et la guerre informationnelle contemporaine. L’impact de ces opérations va bien au-delà des simples nuisances : elles peuvent influencer des décisions politiques, déstabiliser des marchés et engendrer un climat de méfiance généralisée.

Les mécanismes pour contrer la désinformation et renforcer la cybersécurité

La détection et la suppression des comptes en infraction reposent sur des systèmes avancés de modération automatisée couplés à une vigilance humaine renforcée. L’approche d’OpenAI intègre l’analyse comportementale des usages, identifiant rapidement les tentatives d’usage détourné pour des opérations d’influence.

Les efforts se coordonnent également avec d’autres acteurs majeurs du numérique qui, comme Meta, limitent l’accès à certains médias problématiques afin d’endiguer la diffusion de contenus malveillants. Ces collaborations traduisent une volonté claire d’instaurer un environnement numérique plus sûr en 2026.

De plus, les tendances récentes montrent que la cybersécurité passe nécessairement par une compréhension fine des tactiques employées par les malfaiteurs pour exploiter l’IA, que ce soit pour amplifier des campagnes de propagande ou pour créer des arnaques personnalisées.

Perspectives et défis pour prévenir les abus futurs

Alors qu’OpenAI resserre son contrôle sur l’usage de ses technologies, le défi majeur réside dans la rapidité d’adaptation aux nouveaux mécanismes d’arnaques et aux manœuvres d’intoxication. Les opérations d’influence évoluent constamment, mêlant parfois cybermenaces et manipulation psychologique, ce qui nécessite un renforcement continu des outils de détection.

L’exemple de campagnes de désinformation observées aux États-Unis et au Canada, où des services de sonorisation ont été piratés pour diffuser un message politique, illustre magnifiquement la complexité croissante de ces attaques, comme détaillé sur plusieurs systèmes de sonorisation piratés au Canada et aux USA. L’enjeu pour OpenAI et ses partenaires est ainsi de maintenir une posture proactive, où innovation et éthique s’allient pour protéger la sécurité en ligne des utilisateurs et préserver la confiance dans les outils d’intelligence artificielle.