LangChain Core, un pilier pour le développement d’applications utilisant des modèles de langage (LLM), fait face à une faille critique affectant la sécurité des données et la protection des secrets.

Découverte récemment, cette vulnérabilité toucherait directement la sérialisation des données, un processus clé dans la manipulation des informations sensibles. Le risque principal : une injection pouvant aboutir à l’exploitation malveillante des données confidentielles. Plongeons dans cette faille, ses implications, et les mesures déjà prises pour limiter les risques informatiques qu’elle engendre.

Une faille d’injection en sérialisation qui menace LangChain Core

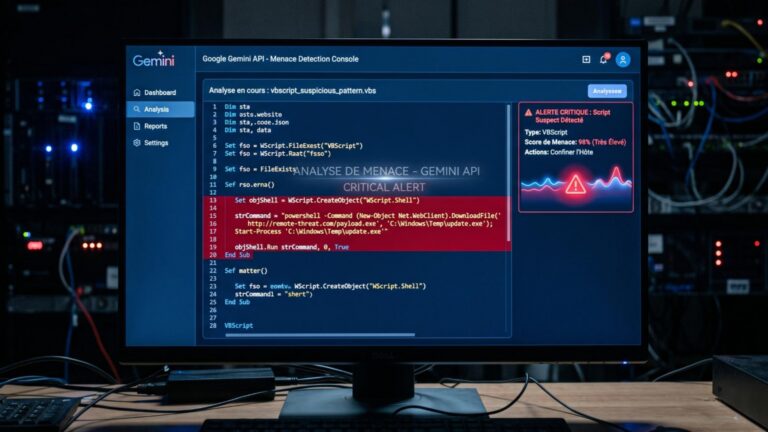

La faille de sécurité identifiée dans LangChain Core, désignée sous le code CVE-2025-68664, met en lumière un problème dans les fonctions de sérialisation dumps() et dumpd(). Ces fonctions, essentielles pour convertir des structures de données en format exploitable par le système, ne filtrent pas correctement les dictionnaires contenant des clés spécifiques baptisées « lc ». Or, ce marqueur « lc » est utilisé en interne par LangChain pour indiquer des objets sérialisés. Une mauvaise gestion de ces données permet à un exploit de surcharger la sérialisation en injectant des objets malicieux, détournant ainsi le processus prévu.

Les conséquences sont variées et préoccupantes. Un attaquant peut extraire des secrets stockés dans les variables d’environnement, surtout si la déserialisation se fait avec l’option « secrets_from_env » activée. Pire encore, cette faille ouvre la porte à l’exécution de code arbitraire en utilisant des templates Jinja2, ce qui étend le spectre des attaques possibles. L’injection via des champs contrôlés par l’utilisateur, comme metadata ou response_metadata, introduit un risque élevé où les réponses du LLM peuvent être elles-mêmes manipulées, brouillant la frontière entre IA et vulnérabilité classique.

Réponses et mises à jour pour contrer cette menace

Face à l’ampleur de la menace, les développeurs de LangChain ont déployé un correctif visant à renforcer les contrôles lors du chargement des objets sérialisés. Une nouvelle option de liste blanche, allowed_objects, filtre désormais les classes acceptées lors du processus de sérialisation et désérialisation. En parallèle, l’utilisation des templates Jinja2 est bloquée par défaut et l’option secrets_from_env est désactivée pour empêcher la fuite automatique des secrets.

Ces évolutions instruisent clairement que la cybersécurité dans le traitement des données sensibles doit s’adapter à la complexité croissante des frameworks intégrant l’intelligence artificielle. Le patch concerne les versions LangChain Core antérieures à 1.2.5 et similaires, rappelant que les mises à jour régulières représentent la meilleure barrière contre ce type de vulnérabilité. Plus d’informations sur des correctifs critiques récents témoignent de la dynamique active de lutte contre les risques informatiques en 2025.

Les implications pour la protection des données et la sécurité informatique

La découverte de cette vulnérabilité est un rappel saisissant sur la fragilité potentielle des systèmes basés sur des LLM. Le cas de LangChain Core illustre comment des fonctions techniques comme la sérialisation, pourtant au cœur des échanges de données, peuvent devenir des points d’entrée pour des attaques sophistiquées. Cela invite les équipes responsables à revoir leurs protocoles pour intégrer une analyse rigoureuse des entrées et une prévention adaptée à la nature particulière des frameworks en intelligence artificielle.

Au-delà des aspects techniques, ce cas soulève la question plus large de la protection des données dans un contexte où les interfaces entre IA et utilisateurs deviennent omniprésentes. L’approche proactive, basée sur des correctifs rapides et le contrôle strict sur les objets manipulés, devient une exigence incontournable. On retrouve cette même actualité dans d’autres vulnérabilités récentes, comme celles documentées dans 7-Zip ou les tensions provoquées par des pannes de services cloud.